Nginx 全面攻略

Nginx 全面攻略

左杰单体节点部署

① 单体结构的部署方式无法承载日益增长的业务流量。

② 当后端节点宕机后,整个系统会陷入瘫痪,导致整个项目不可用。

Nginx反向代理-负载均衡

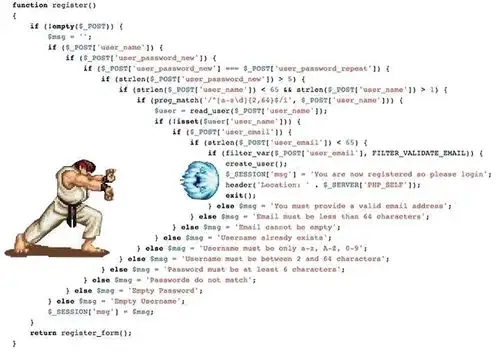

1 | @Controller |

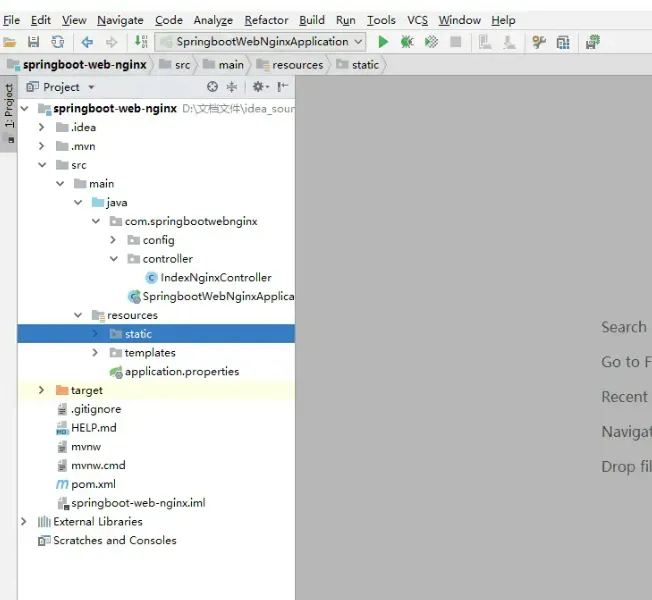

在该Controller类中,存在一个成员变量:port,它的值即是从application.properties配置文件中获取server.port值。当出现访问/资源的请求时,跳转前端index页面,并将该值携带返回。

前端的index.ftl文件代码如下:

1 | <html> |

nginx.conf的配置即可:

1 | upstream nginx_boot{ |

Nginx请求分发原理

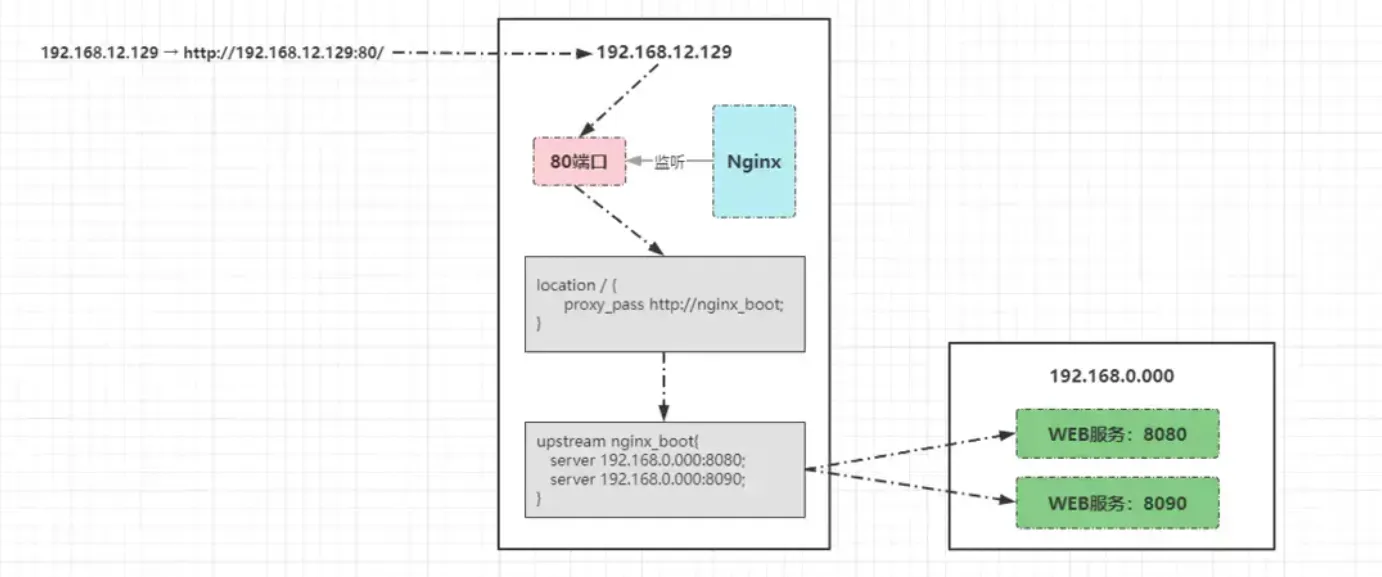

客户端发出的请求192.168.12.129最终会转变为:http://192.168.12.129:80/, 然后再向目标IP发起请求,流程如下:

● 由于Nginx监听了192.168.12.129的80端口,所以最终该请求会找到Nginx进程;

● Nginx首先会根据配置的location规则进行匹配,根据客户端的请求路径/,会定位到location /{}规则;

● 然后根据该location中配置的proxy_pass会再找到名为nginx_boot的upstream;

● 最后根据upstream中的配置信息,将请求转发到运行WEB服务的机器处理,由于配置了多个WEB服务,且配置了权重值,因此Nginx会依次根据权重比分发请求。

Nginx动静分离

动静分离应该是听的次数较多的性能优化方案,那先思考一个问题:「「为什么需要做动静分离呢?它带来的好处是什么?」」 其实这个问题也并不难回答,当你搞懂了网站的本质后,自然就理解了动静分离的重要性

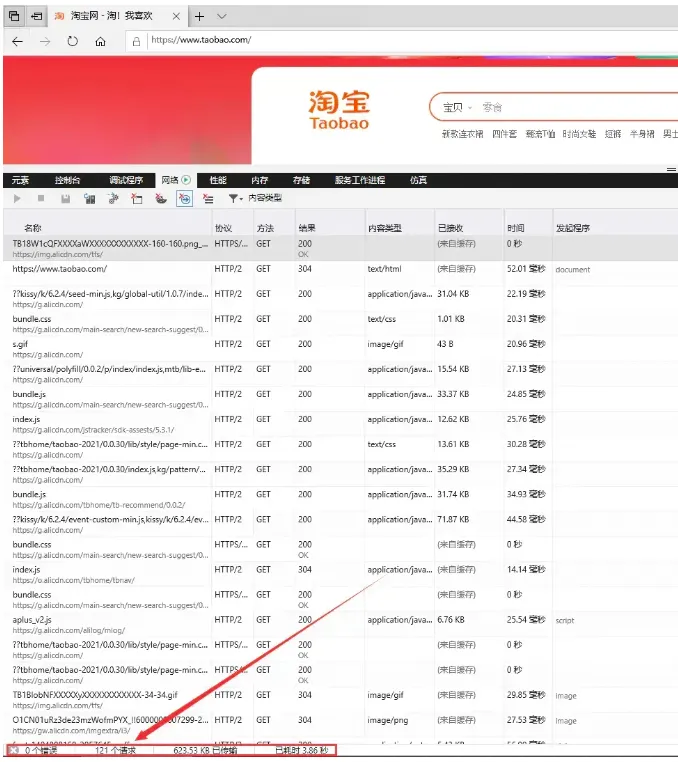

在项目上线部署时,这些静态资源会一起打成包,那此时思考一个问题:「「假设淘宝也是这样干的,那么首页加载时的请求最终会去到哪儿被处理?」」 答案毋庸置疑,首页100+的所有请求都会来到部署WEB服务的机器处理,那则代表着一个客户端请求淘宝首页,就会对后端服务器造成100+的并发请求。毫无疑问,这对于后端服务器的压力是尤为巨大的。

首页100+的请求中,是不是至少有60+是属于*.js、.css、.html、*.jpg…..这类静态资源的请求呢?答案是Yes。

既然有这么多请求属于静态的,这些资源大概率情况下,长时间也不会出现变动,那为何还要让这些请求到后端再处理呢?能不能在此之前就提前处理掉?当然OK,因此经过分析之后能够明确一点:「「做了动静分离之后,至少能够让后端服务减少一半以上的并发量」」。 到此时大家应该明白了动静分离能够带来的性能收益究竟有多大。

- 先在部署Nginx的机器,Nginx目录下创建一个目录static_resources:

1 | mkdir static_resources |

将项目中所有的静态资源全部拷贝到该目录下,而后将项目中的静态资源移除重新打包。

稍微修改一下nginx.conf的配置,增加一条location匹配规则:

1 | location ~ .*\.(html|htm|gif|jpg|jpeg|bmp|png|ico|txt|js|css){ |

最后解读一下那条location规则

● ~代表匹配时区分大小写

● .*代表任意字符都可以出现零次或多次,即资源名不限制

● .代表匹配后缀分隔符.

● (html|…|css)代表匹配括号里所有静态资源类型

Nginx资源压缩

建立在动静分离的基础之上,如果一个静态资源的Size越小,那么自然传输速度会更快,同时也会更节省带宽,因此我们在部署项目时,也可以通过Nginx对于静态资源实现压缩传输,一方面可以节省带宽资源,第二方面也可以加快响应速度并提升系统整体吞吐。

在Nginx也提供了三个支持资源压缩的模块ngx_http_gzip_module、ngx_http_gzip_static_module、ngx_http_gunzip_module,其中ngx_http_gzip_module属于内置模块,代表着可以直接使用该模块下的一些压缩指令

1 | http{ |

Nginx缓冲区

先来思考一个问题,接入Nginx的项目一般请求流程为:“客户端→Nginx→服务端”,在这个过程中存在两个连接:“客户端→Nginx、Nginx→服务端”,那么两个不同的连接速度不一致,就会影响用户的体验(比如浏览器的加载速度跟不上服务端的响应速度)。

其实也就类似电脑的内存跟不上CPU速度,所以对于用户造成的体验感极差,因此在CPU设计时都会加入三级高速缓冲区,用于缓解CPU和内存速率不一致的矛盾。在Nginx也同样存在缓冲区的机制,主要目的就在于:「「用来解决两个连接之间速度不匹配造成的问题」」 ,有了缓冲后,Nginx代理可暂存后端的响应,然后按需供给数据给客户端。先来看看一些关于缓冲区的配置项:

● proxy_buffering:是否启用缓冲机制,默认为on关闭状态。

● client_body_buffer_size:设置缓冲客户端请求数据的内存大小。

● proxy_buffers:为每个请求/连接设置缓冲区的数量和大小,默认4 4k/8k。

● proxy_buffer_size:设置用于存储响应头的缓冲区大小。

● proxy_busy_buffers_size:在后端数据没有完全接收完成时,Nginx可以将busy状态的缓冲返回给客户端,该参数用来设置busy状态的buffer具体有多大,默认为proxy_buffer_size*2。

● proxy_temp_path:当内存缓冲区存满时,可以将数据临时存放到磁盘,该参数是设置存储缓冲数据的目录。

● path是临时目录的路径。

○ 语法:proxy_temp_path path; path是临时目录的路径

● proxy_temp_file_write_size:设置每次写数据到临时文件的大小限制。

● proxy_max_temp_file_size:设置临时的缓冲目录中允许存储的最大容量。

● 非缓冲参数项:

○ proxy_connect_timeout:设置与后端服务器建立连接时的超时时间。

○ proxy_read_timeout:设置从后端服务器读取响应数据的超时时间。

○ proxy_send_timeout:设置向后端服务器传输请求数据的超时时间。

具体的nginx.conf配置如下:

1 | http{ |

上述的缓冲区参数,是基于每个请求分配的空间,而并不是所有请求的共享空间。当然,具体的参数值还需要根据业务去决定,要综合考虑机器的内存以及每个请求的平均数据大小。

“最后提一嘴:使用缓冲也可以减少即时传输带来的带宽消耗。

Nginx缓存机制

对于性能优化而言,缓存是一种能够大幅度提升性能的方案,因此几乎可以在各处都能看见缓存,如客户端缓存、代理缓存、服务器缓存等等,Nginx的缓存则属于代理缓存的一种。对于整个系统而言,加入缓存带来的优势额外明显:

● 减少了再次向后端或文件服务器请求资源的带宽消耗。

● 降低了下游服务器的访问压力,提升系统整体吞吐。

● 缩短了响应时间,提升了加载速度,打开页面的速度更快。

那么在Nginx中,又该如何配置代理缓存呢?先来看看缓存相关的配置项:

**「proxy_cache_path」:**代理缓存的路径。

语法:

1 | proxy_cache_path path [levels=levels] [use_temp_path=on|off] keys_zone=name:size [inactive=time] [max_size=size] [manager_files=number] [manager_sleep=time] [manager_threshold=time] [loader_files=number] [loader_sleep=time] [loader_threshold=time] [purger=on|off] [purger_files=number] [purger_sleep=time] [purger_threshold=time]; |

解释一下每个参数项的含义:

● path:缓存的路径地址。

● levels:缓存存储的层次结构,最多允许三层目录。

● use_temp_path:是否使用临时目录。

● keys_zone:指定一个共享内存空间来存储热点Key(1M可存储8000个Key)。

● inactive:设置缓存多长时间未被访问后删除(默认是十分钟)。

● max_size:允许缓存的最大存储空间,超出后会基于LRU算法移除缓存,Nginx会创建一个Cache manager的进程移除数据,也可以通过purge方式。

● manager_files:manager进程每次移除缓存文件数量的上限。

● manager_sleep:manager进程每次移除缓存文件的时间上限。

● manager_threshold:manager进程每次移除缓存后的间隔时间。

● loader_files:重启Nginx载入缓存时,每次加载的个数,默认100。

● loader_sleep:每次载入时,允许的最大时间上限,默认200ms。

● loader_threshold:一次载入后,停顿的时间间隔,默认50ms。

● purger:是否开启purge方式移除数据。

● purger_files:每次移除缓存文件时的数量。

● purger_sleep:每次移除时,允许消耗的最大时间。

● purger_threshold:每次移除完成后,停顿的间隔时间。

常见缓存配置

1 | http{ |

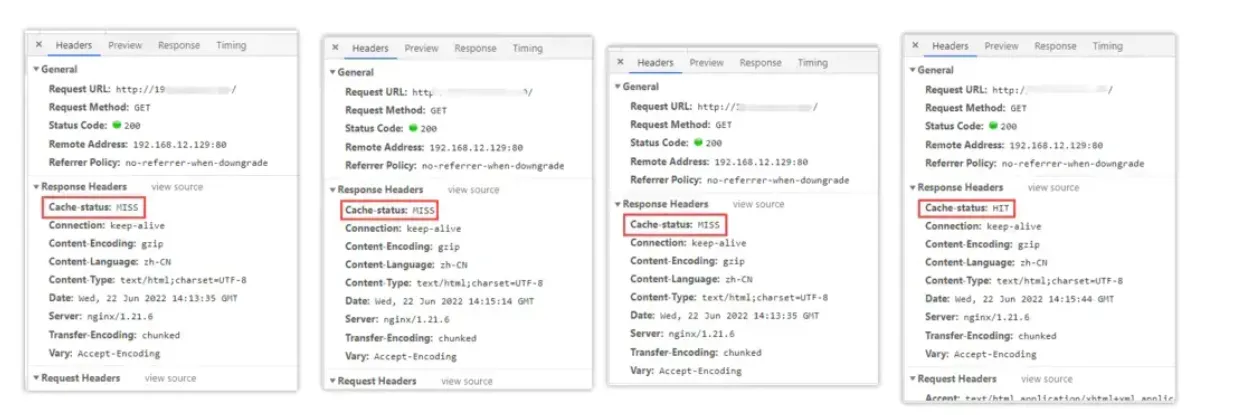

效果如下

第一次访问时,因为还没有请求过资源,所以缓存中没有数据,因此没有命中缓存。第二、三次,依旧没有命中缓存,直至第四次时才显示命中,这是为什么呢?因为在前面的缓存配置中,我们配置了加入缓存的最低条件为:「「资源至少要被请求三次以上才会加入缓存。」」 这样可以避免很多无效缓存占用空间。

缓存清理

当缓存过多时,如果不及时清理会导致磁盘空间被“吃光”,因此我们需要一套完善的缓存清理机制去删除缓存,在之前的proxy_cache_path参数中有purger相关的选项,开启后可以帮我们自动清理缓存,但遗憾的是:purger系列参数只有商业版的NginxPlus才能使用,因此需要付费才可使用。

不过天无绝人之路,我们可以通过强大的第三方模块ngx_cache_purge来替代,先来安装一下该插件:①首先去到Nginx的安装目录下,创建一个cache_purge

Nginx实现IP黑白名单

有时候往往有些需求,可能某些接口只能开放给对应的合作商,或者购买/接入API的合作伙伴,那么此时就需要实现类似于IP白名单的功能。而有时候有些恶意攻击者或爬虫程序,被识别后需要禁止其再次访问网站,因此也需要实现IP黑名单。那么这些功能无需交由后端实现,可直接在Nginx中处理。

Nginx做黑白名单机制,主要是通过allow、deny配置项来实现:

1 | allow xxx.xxx.xxx.xxx; # 允许指定的IP访问,可以用于实现白名单。 |

要同时屏蔽/开放多个IP访问时,如果所有IP全部写在nginx.conf文件中定然是不显示的,这种方式比较冗余,那么可以新建两个文件BlocksIP.conf、WhiteIP.conf:

1 | # --------黑名单:BlocksIP.conf--------- |

可以再将这两个文件在nginx.conf中导入:

1 |

|

Nginx跨域配置

1 | location / { |

Nginx防盗链设计

盗链即是指外部网站引入当前网站的资源对外展示

“好比壁纸网站X站、Y站,X站是一点点去购买版权、签约作者的方式,从而积累了海量的壁纸素材,但Y站由于资金等各方面的原因,就直接通过<img src="X站/xxx.jpg" />`这种方式照搬了X站的所有壁纸资源,继而提供给用户下载。

Nginx的防盗链机制实现,跟一个头部字段:Referer有关,该字段主要描述了当前请求是从哪儿发出的,那么在Nginx中就可获取该值,然后判断是否为本站的资源引用请求,如果不是则不允许访问。Nginx中存在一个配置项为valid_referers,正好可以满足前面的需求

1 | valid_referers none | blocked | server_names | string ...; |

● none:表示接受没有Referer字段的HTTP请求访问。

● blocked:表示允许http://或http//以外的请求访问。

● server_names:资源的白名单,这里可以指定允许访问的域名。

● string:可自定义字符串,支配通配符、正则表达式写法。

1 | # 在动静分离的location中开启防盗链机制 |

Nginx大文件传输配置

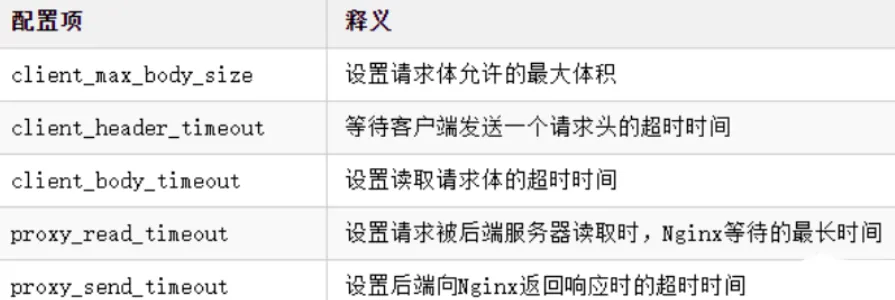

在某些业务场景中需要传输一些大文件,但大文件传输时往往都会会出现一些Bug,比如文件超出限制、文件传输过程中请求超时等,那么此时就可以在Nginx稍微做一些配置,先来了解一些关于大文件传输时可能会用的配置项:

在传输大文件时,client_max_body_size、client_header_timeout、proxy_read_timeout、proxy_send_timeout这四个参数值都可以根据自己项目的实际情况来配置。